NVIDIA

एनवीआईडीआईए ने आधिकारिक तौर पर ए 100, एक पीसीआई 4.0 संगत जीपीयू लॉन्च किया है जो अगले-जीन एम्पीयर आर्किटेक्चर पर आधारित है। हालाँकि, 250W TDP प्रोफ़ाइल की विशेषता के साथ, NVIDIA ने PCIe 4.0 Ampere A100 GPU का वादा किया है, जो पूर्ण 400W A100 HGX GPU के प्रदर्शन के 90 प्रतिशत तक की पेशकश कर सकेगा। अपने बढ़ते हुए एम्पीयर ए 100 जीपीयू परिवार का तीसरा संस्करण, ए 100 पीसीआई आर्टिफिशियल इंटेलिजेंस (एआई), डेटा साइंस और सुपरकंप्यूटिंग क्लस्टर चलाने वाले सर्वरों के लिए है।

NVIDIA ने A100 GPU के पीसीआई-एक्सप्रेस 4.0 संस्करण का खुलासा किया। GPU 7nm Ampere माइक्रोआर्किटेक्चर पर आधारित है। इसके अतिरिक्त, कंपनी ने आसुस, डेल, सिस्को, लेनोवो, और अन्य सहित प्रमुख सर्वर निर्माताओं से कई ए 100 पावर्ड सिस्टमों की भी घोषणा की। 250W A100 PCIe 4.0 GPU त्वरक पूर्ण 400W TDP संस्करण के समान है, और TDP प्रोफ़ाइल में महत्वपूर्ण गिरावट के बावजूद NVIDIA समान प्रदर्शन के निकट है।

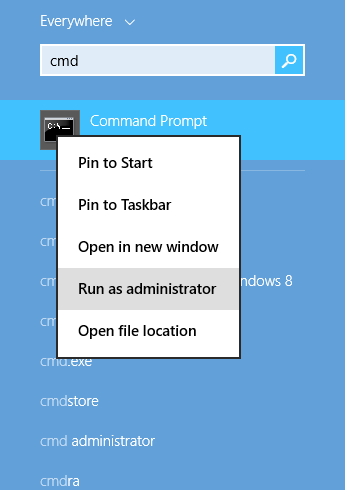

पीसीआई में NVIDIA A100 एम्पियर जीपीयू 4.0 फॉर्म-फैक्टर के साथ समान 400W A100 HGX GPU कॉन्फ़िगरेशन लेकिन 250W पर:

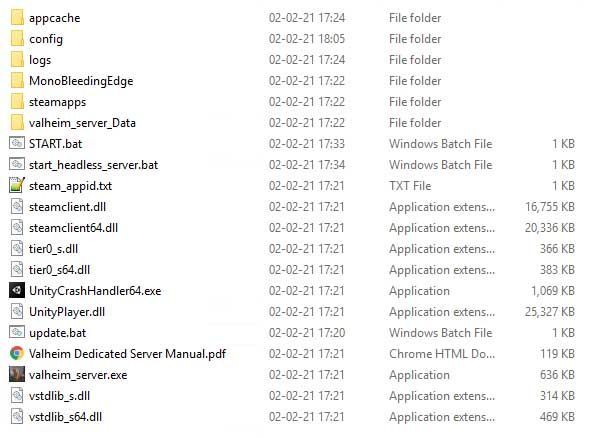

NVIDIA ने अपने PCIe 4.0 A100 PCIe GPU त्वरक की घोषणा की है। Ampere GPU एक एकल A100 PCIe GPU से लेकर 12 NVLINK चैनलों के माध्यम से एक ही समय में दो कार्डों का उपयोग करने वाले सर्वरों के साथ औद्योगिक उपयोग के मामलों के विविध सेट के लिए उपलब्ध है, जो कुल 600 GB / s का इंटरकनेक्ट बैंडविड्थ प्रदान करते हैं। जब 400W A100 HGX GPU की तुलना में 250W TDP A100 PCIe GPU त्वरक कोर विन्यास के मामले में ज्यादा नहीं बदलता है।

इस साल आईएससी डिजिटल में, @nvidia इसकी A100 के आसपास घोषणाएं की गईं #GPU , और एक नया #AI मंच के लिए #supercomputing , #NVIDIA मेलानॉक्स यूएफएम साइबर-एआई प्लेटफार्म। यहां विवरण प्राप्त करें! ☺️ #तकनीक सम्बन्धी समाचार @NVIDIADC @NVIDIAAI @mellanoxtech #AI #सोमवार की सुबह https://t.co/YXrFGlTYJ0

- StorageReview.com (@storagereview) 22 जून, 2020

GA100 GPU में 400W A100 HGX वैरिएंट के विनिर्देशों के साथ 6912 CUDA कोर की व्यवस्था की गई है जो 108 SM इकाइयों, 432 Tensor Cores और 40 GB HBM2 मेमोरी में व्यवस्थित है, जो कि 1.55 टीबी / s (1.6 टीबी / से दूर) की एक ही मेमोरी बैंडविड्थ प्रदान करता है। रों)। हालांकि, पर GPU पैकेज को तैनात करना PCIe 4.0 मानक टीडीपी को कम करने का अपना दोष था। कथित तौर पर इसका मतलब है कार्यभार के आधार पर 10 से 50 प्रतिशत प्रदर्शन जुर्माना। इसके अलावा, A100 GPU का 250W TDP वैरिएंट निरंतर भार के बजाय शॉर्ट बर्स्ट के लिए अधिक अनुकूल है।

PCIe 4.0 फॉर्म-फैक्टर प्रदर्शन में NVIDIA A100 एम्पीयर GPU:

टीडीपी प्रोफ़ाइल में महत्वपूर्ण कमी के कारण, यह माना जा सकता है कि कार्ड कम टीडीपी इनपुट के लिए क्षतिपूर्ति करने के लिए कम घड़ियों की सुविधा प्रदान करेगा। हालाँकि, NVIDIA ने जो प्रदर्शन मेट्रिक्स जारी किए हैं वे वास्तव में आश्चर्यजनक हैं क्योंकि वे 400W टीडीपी संस्करण के काफी करीब आते हैं। FP64 का प्रदर्शन अभी भी 9.7 / 19.5 TFLOPs में मूल्यांकन किया गया है, FP32 का प्रदर्शन 19.5 / 156/312 TFLOPs (स्पार्सिटी) में मूल्यांकन किया गया है, FP16 के प्रदर्शन को 312/624 TFLOPs (स्पार्सिटी) में, और INT8 को 624/1248 TOP () में रेट किया गया है विरलता)।

[PR] GIGABYTE जी-सीरीज़ सर्वरों के एक व्यापक पोर्टफोलियो को NVIDIA A100 PCIe द्वारा संचालित करता है https://t.co/Jxjrjzpl0F pic.twitter.com/Lr5KNvhx09

- TechPowerUp (@TechPowerUp) 22 जून, 2020

सरल गणित इंगित करता है, और NVIDIA आश्वासन देता है, Ampere- आधारित PCIe 4.0 250W A100 GPU शीर्ष सर्वर अनुप्रयोगों में A100 HGX कार्ड (400W) के प्रदर्शन का 90 प्रतिशत वितरित कर सकता है। यह उचित है क्योंकि नए संस्करण के लिए उपरोक्त कार्यों को पूरा करने में कम समय लगता है। हालांकि, संख्या केवल छोटे अंतराल के लिए मान्य होनी चाहिए। जटिल परिस्थितियों में, जिन स्थितियों में निरंतर GPU क्षमताओं की आवश्यकता होती है, 250W PCIe 4.0 GPU 400W A100 HGX GPU के प्रदर्शन को 90 प्रतिशत से 50 प्रतिशत तक कहीं भी पहुंचा सकता है।

सुपरमाइक्रो नए के लिए पूर्ण समर्थन के साथ GPU सिस्टम के उद्योग-अग्रणी पोर्टफोलियो का विस्तार करता है @NVIDIA A100 PCI-E GPU एक दर्जन से अधिक प्रणालियों पर।

और अधिक जानें: https://t.co/K8g41s7sKv #NVIDIA #Supermicro # A100 #AI #HPC #GPU @NVIDIADC pic.twitter.com/9og6gfdrlw

- सुपरमाइक्रो (@Supermicro_SMCI) 22 जून, 2020

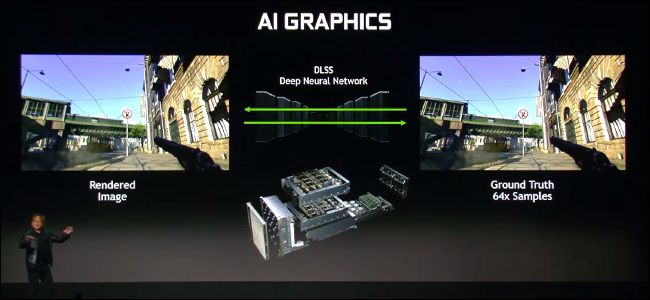

एम्पीयर माइक्रोआर्किटेक्चर निश्चित रूप से नए ए 100 को लाभान्वित करेगा। NVIDIA वोल्टा-आधारित पूर्ववर्ती पर कम से कम 20X प्रदर्शन को बढ़ावा देने का वादा करता है। PCIe 4.0 A100 GPU में मल्टी-इंस्टेंस GPU तकनीक है। इसका मतलब है कि एकल A100 को विभिन्न कंप्यूटिंग कार्यों को संभालने के लिए सात अलग-अलग GPU के रूप में विभाजित किया जा सकता है। हालांकि यह विभाजन को बढ़ाता है, वहाँ 3-जीन NVLink है, जो कई GPU को एक विशाल GPU में शामिल होने में सक्षम बनाता है।

टैग NVIDIA